2.1.1 — L'economia del compute

In tre mesi, NVIDIA ha incassato 57 miliardi di dollari, guadagnandone 36 con un margine del 75%. Numeri incomprensibili. Proviamo a capirli. Il valore di mercato di NVIDIA supera quello di tutte le aziende svizzere quotate a Zurigo messe insieme — Rolex, Nestlé, ABB, Novartis incluse — e delle 20 aziende più importanti d'Europa (ASML, LVMH, SAP…) (🍫 ff.139.1 Svizzero? No, NVIDIA). Non è corretto confrontare capitalizzazione di borsa con PIL — il primo è valore teorico percepito, il secondo è quanto fisicamente prodotto in un anno — ma la metafora rende l'idea della sproporzione. Se il mercato fosse un campionato di fantacalcio, per acquistare NVIDIA dovreste vendere l'intera squadra europea. Jensen Huang, sul palco del COMPUTEX 2025, non ha presentato un chip: ha presentato una visione del mondo dove l'unità di misura è il watt di calcolo[1].

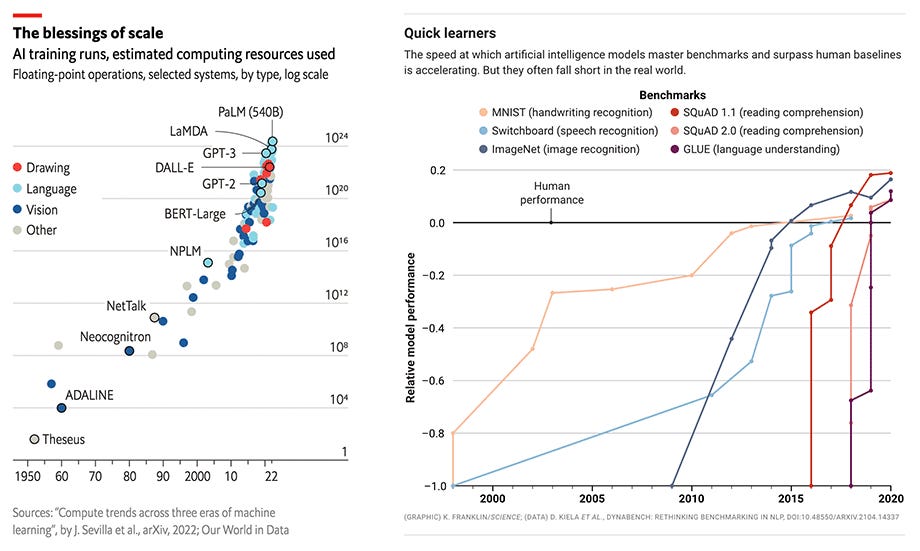

ARC-AGI-3 è oggi l'unico benchmark agentico al mondo ancora non saturato: gli umani lo risolvono al 100%, i modelli AI stanno sotto l'1% (benchmark ARC-AGI-3[2]). La domanda che pone è diversa da tutti i precedenti: non misura cosa il modello sa, ma come impara regole nuove in contesto. Il gap tra 100% umano e sotto l'1% AI è il più grande osservato in qualsiasi benchmark dell'ultimo decennio. In 😊 ff.148.2 Sinner e altri peccati il tema era la singolarità nel codice come prima spillover fisica; ARC-AGI-3 mostra il rovescio della medaglia: in ragionamento agentico ex-novo, il divario umano-AI è ancora abissale. Il termine "AGI" usato dai marketing di San Francisco è molto più lontano di quanto i keynote lascino credere.

Perché tutto questo hype? Perché l'AI si sta mostrando economicamente fruttifera a una velocità senza precedenti. Dave Blundin, nel podcast MOONSHOT, osserva che il mercato delle pubblicità online — 600 miliardi di dollari — è già interamente gestito da algoritmi. Agenti con capacità più spinte (e-commerce, contrattazione di materie prime, pianificazione finanziaria) possono creare un mercato di almeno 1.000 miliardi, l'1% circa del PIL mondiale (🧃 ff.139.2 Combini e paperclips). Le nuove classifiche dell'AI non sono più solo cognitive ma economiche: Alpha Arena misura le performance in finanza; Vending-Bench 2 valuta abilità di vendita, contrattazione e pianificazione a lungo termine. Il 50% dei ricavi API di Anthropic[3] proviene da strumenti di coding come GitHub Copilot e Cursor. L'ottimizzazione economica a lungo termine richiama alla mente il minigioco del paperclip maximizer, citato da Nick Bostrom come esempio di superefficienza che potrebbe portare all'estinzione (🦉 ff.36.2 Il super-librozzo sulla singolarità).

Ma quanto costa far girare questa macchina? L'energia è il vincolo più concreto dell'era AI. Generare una singola immagine con un modello di diffusione consuma circa 0,5 Wh — quanto una lampadina LED accesa per tre minuti. Una richiesta Gemini consuma 0,24 Wh; un'ora di streaming Netflix 36 Wh[4] — quanto 400 richieste. Sembra poco, ma moltiplicato per miliardi di richieste giornaliere il conto sale. Secondo la Federal Reserve, il consumo legato all'AI potrebbe far salire il prezzo dell'elettricità negli USA da 0,17 a 0,19 dollari per kWh (💲 ff.135.1 I costi dell'Intelligenza Artificiale). Elon Musk prevede 50 milioni di GPU H100 attive entro il 2026; a regime, 35 GW di potenza computazionale — il 2% dell'elettricità globale[5] — dedicati esclusivamente al calcolo AI (🌊 ff.135.2 Onda anomala energetica). Fortunatamente, una soluzione arriva dalla natura stessa: il solare in soli 10 anni è passato da 0 a 2073 TWh, con investimenti da 500 miliardi che hanno superato quelli per l'aviazione durante la Seconda guerra mondiale — un ponte diretto tra la fame energetica dell'AI e la transizione ecologica raccontata nel capitolo Natura (💥 ff.70.3 Che bomba i pannelli solari!).

In tre mesi, NVIDIA ha incassato 57 miliardi di dollari con un margine del 75%. Generare una singola immagine AI consuma 0,5 Wh, ma moltiplicato per miliardi di richieste giornaliere, Elon Musk prevede 50 milioni di GPU H100 attive entro il 2026: 35 GW di potenza, il 2% dell'elettricità globale dedicato esclusivamente al calcolo AI.

“[La singolarità] da lontano appare come un asintoto verticale, ma quando ci sei in mezzo, sembra abbastanza continuo.”

— Alex Wissner-Gross

Da dentro la curva, infatti, le promesse si fanno megafone. Sam Altman ha dichiarato che “con 10 GW di calcolo, l'AI può curare il cancro”[6]. È un'affermazione grandiosa, ma il trend è reale: i costi marginali del compute scendono del 70% all'anno. Il modello M6 di Alibaba, con 10 trilioni di parametri, ha consumato solo l'1% dell'energia di GPT-3, dimostrando che l'efficienza è possibile (🏢 ff.2.1 Un modello “grande” come New York). I numeri meritano un approfondimento: il training di GPT-3 di OpenAI è costato circa 12 milioni di dollari[7]; il modello M6 di Alibaba, con prestazioni 50 volte superiori in termini di parametri, ha richiesto l'1% del consumo energetico — solo 512 GPU in 10 giorni. Le sinapsi nel cervello umano sono 125 trilioni; M6 ne simula 10 trilioni, un ordine di grandezza che inizia a non essere più trascurabile. Il Made in China dell'intelligenza artificiale non è una copia a basso costo: è un'alternativa efficiente che riscrive le regole della competizione. Se il treno dell'AI parte da San Francisco, la Cina non insegue — costruisce un binario parallelo con meno carburante e più passeggeri (🇨🇳 ff.2.2 Alibaba e l'alternativa efficiente). Nel frattempo il professore Wang Yu, alla AI Conference di Shanghai, ha coniato il “watt-to-bit” — parametro per classificare l'efficienza dei modelli. La Cina, costretta dall'embargo sulle GPU a spremere ogni granello di caffè dalle macchine meno performanti, ne ha fatto una necessità strategica: l'ARC Prize include già il costo per task nella sua leaderboard (☕ ff.135.4 L'AGI avanza: il “caffè” cinese). L’AI non è solo una corsa a benchmark: è una riorganizzazione di lavoro e decisioni. Il punto non è prevedere tutto, ma mantenere governabile l’accelerazione — tema che ritornerà più sotto, quando parleremo di singolarità gentile.

Eppure, prima di celebrare l’accelerazione, serve ricordare che non tutti i settori la vivono. Negli ultimi cinquant’anni il progresso è stato reale, ma la stagnazione tecnologica in alcune aree è innegabile. Lo strano caso del dottor Eroom e mister Moore: il costo dello sviluppo di farmaci raddoppia ogni anno[8] — per il monopolio delle big pharma o per la regolamentazione imposta da una società più spaventata che attratta dalla tecnologia. Siamo saliti sulla Luna nel 1969, e solo oggi, dopo che Musk ha inventato i razzi riutilizzabili per abbattere i costi, torniamo a sognarla. Nonostante i molti PhD — che però non crescono più come prima degli anni Settanta[9] — il progresso scientifico di base è in stasi: a inizio Novecento meccanica quantistica e relatività, oggi siamo fermi al modello standard da vari decenni. Vaclav Smil in Growth: From Microorganisms to Megacities[10] raccoglie molti grafici logistici[11] dove si vede una saturazione delle efficienze di molti sistemi meccanici, tutti inventati a inizio secolo e mai realmente sostituiti. Come dice Peter Thiel: “Ci erano state promesse le macchine volanti, oggi abbiamo invece 140 caratteri.” La parola tecnologia oggi coincide con information technology, mentre nel 1960 significava viaggi nello spazio e nucleare. La lettura più onesta è che ai tempi della guerra fredda la de-regolamentazione fu talmente forte da portare alcune tecnologie “in anticipo” la Legge di Moore è la più celebre perché i chip sono stati il primo esempio di loop positivo tra processo e risultato. Oggi quel loop si sposta: dalla diminishing marginal utility[12] dei PC alla potenza computazionale che favorisce salti qualitativi in genetica, robotica e AI — la stessa accelerazione che ha prodotto la corsa all’AGI (💻 ff.50.3 La stagnazione tecnologica).

500 milioni di anni fa, l’esplosione cambriana[13]: un nuovo organismo capace di produrre ossigeno ha probabilmente “soffocato” le forme di vita che respiravano CO₂. Oggi, la CO₂ torna protagonista, ma dalla parte sbagliata. Le emissioni legate all’AI stanno crescendo[14]: uno scambio con ChatGPT equivale a un’ora di luce LED, un’immagine DALL-E a una ricarica di smartphone. Il computronio[15] — la materia riconfigurata per calcolare — sarà la prossima forma di vita? Prima di rispondere, serve contestualizzare: paragonare ChatGPT a una lampadina LED è fuorviante, perché la lampadina è il risultato di un secolo di miglioramenti, mentre l’AI è al suo primo decennio di massa. E quante ricerche Google previene ogni singola risposta di ChatGPT? L’MIT nota che il consumo dell’AI può portare benefici netti[16] e che soluzioni di efficientamento esistono già: dalla diffusione di Small Nuclear Reactors proposti da Microsoft[17] alla gestione ottimizzata delle risorse computazionali[18] (🦖 ff.82.1 Estinzione di massa?).

Ma il momento in cui l’economia del compute è diventata visibile a tutti ha un nome e una data precisa. ChatGPT ha raggiunto un milione di utenti in cinque giorni — come un concerto digitale con duecentomila spettatori diversi al giorno, per una settimana intera. OpenAI ha sette anni; il valore stimato di ChatGPT — 15 dei 29 miliardi di dollari della società — è paragonabile a quello della Ferrari. La cosa più sbalorditiva non è la tecnologia: è il fatto che OpenAI Playground, la stessa identica tecnologia, era già accessibile da mesi[19], eppure quasi nessuno ci aveva giocato. Meno attrito, più utilizzo: bastava un’interfaccia chat al posto di un playground tecnico per trasformare una curiosità di nicchia nell’applicazione più veloce della storia a raggiungere il grande pubblico (🗣️ ff.48.1 Tutti parlano di ChatGPT).

Una carrellata di applicazioni più serie. McKinsey raccoglie tutte le applicazioni che GPT può avere in azienda[20]: il salto ottenuto con questa tecnologia è paragonabile a quello delle ricerche di Google — le informazioni erano lì, ma era difficile accedervi. Cambridge Analytica, spostati. Kantrowitz ha chiesto al bot di immaginare la propria chimera[21], e il futuro distopico immaginato dall’AI recita: “the true horror of ChatGPT isn’t just in its appearance, but in its actions…”. GPT-3 stima meglio del predecessore se una legge è di interesse per un’azienda[22] — e nel caso lo sia, scrive una lettera di persuasione per deviare scelte politiche. E poi c’è chi ha chiesto di spiegare a un cane cosa sia il codice HTML[23] (🤖 ff.48.3 AI tutto fare).

Ma quando il parrucchiere chiede consigli su NVIDIA, è solitamente tempo di vendere. Il prezzo dell’azione segue una curva esponenziale, come quella delle emissioni di CO₂. Dietro a tutto: l’allenamento di LLM sulle GPU sempre più performanti dell’azienda americana. È una bolla? Forse no: NVIDIA negli ultimi tre anni ha triplicato la revenue solo nell’ultimo anno. Rispetto alla bolla dot-com degli anni 2000, il settore tecnologico è scontato del 50% — i multipli sono la metà di quelli che hanno preceduto il crollo. Se il compute è il nuovo petrolio, NVIDIA è la nuova Saudi Aramco. Ma la storia insegna che anche le Saudi Aramco possono deludere (📈 ff.88.1 Una bolla finanziaria?).

La corsa ai datacenter somiglia a una corsa agli armamenti. I System of a Down in Cigaro trattavano la competizione tra superpotenze con un’analogia brutale: i datacenter potrebbero essere i prossimi razzi, le prossime trincee. Modelli più piccoli ed efficienti esistono — Mistral, la startup francese, compete con risultati paragonabili ai Golia GPT-4 e Gemini[24] — ma scalare i parametri e la potenza di calcolo produce risultati sistematicamente migliori. Non è scontato avere una tecnologia che migliora semplicemente allocando più risorse: le turbine eoliche e i motori a scoppio seguono curve di innovazione “a S”[25], dove dopo un certo punto i rendimenti crollano. L’AI, per ora, non mostra quel plateau: ogni ordine di grandezza in più di compute apre capacità qualitativamente nuove. La domanda non è se la corsa sia razionale, ma quanto tempo durerà prima che la S-curve si manifesti (🐔 ff.82.2 Polli computazionali).

E l’economia del compute ha appena prodotto il suo nuovo mito. Il rilascio di Claude Mythos — un pdf tecnico da 245 pagine — segnala che il nuovo modello di Anthropic è talmente potente che, se rilasciato subito, potrebbe causare problemi concreti: ha scovato falle in sistemi alla base di internet, incluso un bug in OpenBSD rimasto nascosto per 27 anni in un sistema operativo noto per la sua sicurezza granitica. Non è più l’AI che scrive poesie: è l’AI che buca le fondamenta digitali dell’economia. Per il codice, succede oggi quello che successe per il Go con la mossa 37 di AlphaGo: anche i campioni del mondo vengono battuti. La risposta di Anthropic — con Apple, Amazon, Cisco — è il progetto Glasswing, per dare all’AI ali trasparenti come il vetro. Trasparenza come presupposto di sicurezza: quando la macchina trova falle invisibili, l’unico modo per fidarsi è vedere dentro. La singolarità gentile (🕳️ ff.129.1 La singolarità gentile di Altman) ha appena mostrato che, sulla sicurezza del software, la gentilezza finisce dove inizia il bug di 27 anni (🐉 ff.148.1 Claude Mythos: non per tutti).

E il mercato sta prezzando questa traiettoria in modo quasi ridicolo. Coatue proietta Anthropic a 2,4 trilioni di valutazione nel 2031[26] su 200 miliardi di revenue e 48 miliardi di EBITDA. Due virgola quattro trilioni significa superare oggi la capitalizzazione di Apple. Se le proiezioni sono anche solo a metà giuste, stiamo assistendo alla nascita contemporanea di due colossi — Anthropic e OpenAI — ciascuno con una capitalizzazione attesa simile a quella delle Magnificent Seven di oggi. Il dubbio da porsi non è se la bolla esista (📈 ff.88.1 Una bolla finanziaria?), ma quale frazione degli investitori si rivelasse razionale nel 2031: se il 30%, il settore tecnologico varrà il doppio di oggi; se il 5%, molti capital stack faranno la fine dei protagonisti del 2000.

Il vincolo reale, però, non è il compute: è la memoria. TurboQuant di Google comprime la KV cache dei LLM senza retraining[27], con guadagni drammatici di efficienza su Gemma, Mistral e Llama-3.1. La cache chiave-valore è ciò che tiene in RAM il contesto di conversazione di un modello: più è lunga, più memoria serve, più costa ogni token. Tagliarla online senza degradare la qualità significa rendere l’inference economicamente sostenibile anche a contesti da milioni di token. È il secondo tempo della curva di Wright: il primo tempo ha reso il training 70% più economico all’anno (☕ ff.135.4 L’AGI avanza: il “caffè” cinese), il secondo sta rendendo l’inference democratica. Chi oggi paga il token paga perché la memoria non basta, non perché il calcolo non c’è. La direzione è già chiara: 📎 AlphaEvolve scopre varianti algoritmiche per l’inference di Gemini con −74% di memoria e 6.8× di runtime — quando l’AI ottimizza l’AI, la curva di Wright si auto-accelera.

E la guerra è soprattutto tra aziende. NVIDIA produrrà nel 2024 1 milione di GPU H100 (40.000 dollari l’una, con performance 9 volte superiori rispetto alla A100). Noam Shazeer, CEO di Character.ai, calcola che abbiamo abbastanza GPU per sostenere un modello GPT-4 a persona. Ma non c’è computronio per tutti: Tesla si è accaparrata solo 15.000 GPU; anche OpenAI, nonostante la partnership con Microsoft, non ha tutte le risorse necessarie. Come sempre visionario, Musk sta costruendo la sua indipendenza con Dojo, il supercomputer tailor-made che nel 2024 sarà nella top 5 mondiale. Davide tra i Gol-IA: il ricercatore della Columbia Ishan Dhanani vuole democratizzare l’accesso al computronio, decentralizzando (🥵 ff.82.4 Guerra calda).

Lo studio Stanford di Brynjolfsson, Chandar e Chen mostra un segnale inequivocabile: i lavoratori 22-25 anni in ruoli ad alta esposizione AI — software, marketing, customer service — registrano cali significativi di occupazione[28], mentre le fasce senior tengono. I giovani sono i canarini dell'AI perché entrano in mansioni standardizzabili e ripetitive; la domanda vera riguarda il coefficiente di ritardo con cui l'onda arriverà ai ruoli senior.

Nel campo quantistico ogni player importante punta sui qubit superconduttori; PsiQuantum è l'unico grande attore a scommettere sulla fotonica quantistica[29], con un round guidato da BlackRock, Temasek, Baillie Gifford, NVIDIA e Qatar Investment Authority. Se la fotonica vince la gara sull'errore-correzione scalabile, chi ha costruito l'infrastruttura ottica del networking esistente — fibre, commutatori, detector monofotone — si ritrova un vantaggio strutturale incolmabile per qualsiasi corsa al silicio.