2.1 — Robotica e AI

2.1.1 — L'economia del compute

→ Apri come pagina indipendente — bibliografia + nav dedicata

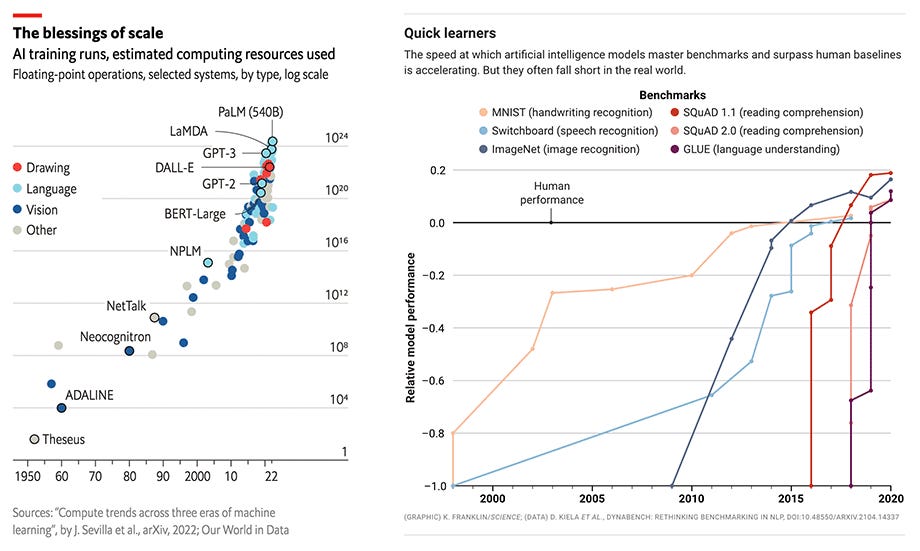

In tre mesi, NVIDIA ha incassato 57 miliardi di dollari, guadagnandone 36 con un margine del 75%. Numeri incomprensibili. Proviamo a capirli. Il valore di mercato di NVIDIA supera quello di tutte le aziende svizzere quotate a Zurigo messe insieme — Rolex, Nestlé, ABB, Novartis incluse — e delle 20 aziende più importanti d'Europa (ASML, LVMH, SAP…) (🍫 ff.139.1 Svizzero? No, NVIDIA). Non è corretto confrontare capitalizzazione di borsa con PIL — il primo è valore teorico percepito, il secondo è quanto fisicamente prodotto in un anno — ma la metafora rende l'idea della sproporzione. Se il mercato fosse un campionato di fantacalcio, per acquistare NVIDIA dovreste vendere l'intera squadra europea. Jensen Huang, sul palco del COMPUTEX 2025, non ha presentato un chip: ha presentato una visione del mondo dove l'unità di misura è il watt di calcolo[1].

ARC-AGI-3 è oggi l'unico benchmark agentico al mondo ancora non saturato: gli umani lo risolvono al 100%, i modelli AI stanno sotto l'1% (benchmark ARC-AGI-3[2]). La domanda che pone è diversa da tutti i precedenti: non misura cosa il modello sa, ma come impara regole nuove in contesto. Il gap tra 100% umano e sotto l'1% AI è il più grande osservato in qualsiasi benchmark dell'ultimo decennio. In 😊 ff.148.2 Sinner e altri peccati il tema era la singolarità nel codice come prima spillover fisica; ARC-AGI-3 mostra il rovescio della medaglia: in ragionamento agentico ex-novo, il divario umano-AI è ancora abissale. Il termine "AGI" usato dai marketing di San Francisco è molto più lontano di quanto i keynote lascino credere.

Perché tutto questo hype? Perché l'AI si sta mostrando economicamente fruttifera a una velocità senza precedenti. Dave Blundin, nel podcast MOONSHOT, osserva che il mercato delle pubblicità online — 600 miliardi di dollari — è già interamente gestito da algoritmi. Agenti con capacità più spinte (e-commerce, contrattazione di materie prime, pianificazione finanziaria) possono creare un mercato di almeno 1.000 miliardi, l'1% circa del PIL mondiale (🧃 ff.139.2 Combini e paperclips). Le nuove classifiche dell'AI non sono più solo cognitive ma economiche: Alpha Arena misura le performance in finanza; Vending-Bench 2 valuta abilità di vendita, contrattazione e pianificazione a lungo termine. Il 50% dei ricavi API di Anthropic[3] proviene da strumenti di coding come GitHub Copilot e Cursor. L'ottimizzazione economica a lungo termine richiama alla mente il minigioco del paperclip maximizer, citato da Nick Bostrom come esempio di superefficienza che potrebbe portare all'estinzione (🦉 ff.36.2 Il super-librozzo sulla singolarità).

Ma quanto costa far girare questa macchina? L'energia è il vincolo più concreto dell'era AI. Generare una singola immagine con un modello di diffusione consuma circa 0,5 Wh — quanto una lampadina LED accesa per tre minuti. Una richiesta Gemini consuma 0,24 Wh; un'ora di streaming Netflix 36 Wh[4] — quanto 400 richieste. Sembra poco, ma moltiplicato per miliardi di richieste giornaliere il conto sale. Secondo la Federal Reserve, il consumo legato all'AI potrebbe far salire il prezzo dell'elettricità negli USA da 0,17 a 0,19 dollari per kWh (💲 ff.135.1 I costi dell'Intelligenza Artificiale). Elon Musk prevede 50 milioni di GPU H100 attive entro il 2026; a regime, 35 GW di potenza computazionale — il 2% dell'elettricità globale[5] — dedicati esclusivamente al calcolo AI (🌊 ff.135.2 Onda anomala energetica). Fortunatamente, una soluzione arriva dalla natura stessa: il solare in soli 10 anni è passato da 0 a 2073 TWh, con investimenti da 500 miliardi che hanno superato quelli per l'aviazione durante la Seconda guerra mondiale — un ponte diretto tra la fame energetica dell'AI e la transizione ecologica raccontata nel capitolo Natura (💥 ff.70.3 Che bomba i pannelli solari!).

In tre mesi, NVIDIA ha incassato 57 miliardi di dollari con un margine del 75%. Generare una singola immagine AI consuma 0,5 Wh, ma moltiplicato per miliardi di richieste giornaliere, Elon Musk prevede 50 milioni di GPU H100 attive entro il 2026: 35 GW di potenza, il 2% dell'elettricità globale dedicato esclusivamente al calcolo AI.

“[La singolarità] da lontano appare come un asintoto verticale, ma quando ci sei in mezzo, sembra abbastanza continuo.”

— Alex Wissner-Gross

Da dentro la curva, infatti, le promesse si fanno megafone. Sam Altman ha dichiarato che “con 10 GW di calcolo, l'AI può curare il cancro”[6]. È un'affermazione grandiosa, ma il trend è reale: i costi marginali del compute scendono del 70% all'anno. Il modello M6 di Alibaba, con 10 trilioni di parametri, ha consumato solo l'1% dell'energia di GPT-3, dimostrando che l'efficienza è possibile (🏢 ff.2.1 Un modello “grande” come New York). I numeri meritano un approfondimento: il training di GPT-3 di OpenAI è costato circa 12 milioni di dollari[7]; il modello M6 di Alibaba, con prestazioni 50 volte superiori in termini di parametri, ha richiesto l'1% del consumo energetico — solo 512 GPU in 10 giorni. Le sinapsi nel cervello umano sono 125 trilioni; M6 ne simula 10 trilioni, un ordine di grandezza che inizia a non essere più trascurabile. Il Made in China dell'intelligenza artificiale non è una copia a basso costo: è un'alternativa efficiente che riscrive le regole della competizione. Se il treno dell'AI parte da San Francisco, la Cina non insegue — costruisce un binario parallelo con meno carburante e più passeggeri (🇨🇳 ff.2.2 Alibaba e l'alternativa efficiente). Nel frattempo il professore Wang Yu, alla AI Conference di Shanghai, ha coniato il “watt-to-bit” — parametro per classificare l'efficienza dei modelli. La Cina, costretta dall'embargo sulle GPU a spremere ogni granello di caffè dalle macchine meno performanti, ne ha fatto una necessità strategica: l'ARC Prize include già il costo per task nella sua leaderboard (☕ ff.135.4 L'AGI avanza: il “caffè” cinese). L’AI non è solo una corsa a benchmark: è una riorganizzazione di lavoro e decisioni. Il punto non è prevedere tutto, ma mantenere governabile l’accelerazione — tema che ritornerà più sotto, quando parleremo di singolarità gentile.

Eppure, prima di celebrare l’accelerazione, serve ricordare che non tutti i settori la vivono. Negli ultimi cinquant’anni il progresso è stato reale, ma la stagnazione tecnologica in alcune aree è innegabile. Lo strano caso del dottor Eroom e mister Moore: il costo dello sviluppo di farmaci raddoppia ogni anno[8] — per il monopolio delle big pharma o per la regolamentazione imposta da una società più spaventata che attratta dalla tecnologia. Siamo saliti sulla Luna nel 1969, e solo oggi, dopo che Musk ha inventato i razzi riutilizzabili per abbattere i costi, torniamo a sognarla. Nonostante i molti PhD — che però non crescono più come prima degli anni Settanta[9] — il progresso scientifico di base è in stasi: a inizio Novecento meccanica quantistica e relatività, oggi siamo fermi al modello standard da vari decenni. Vaclav Smil in Growth: From Microorganisms to Megacities[10] raccoglie molti grafici logistici[11] dove si vede una saturazione delle efficienze di molti sistemi meccanici, tutti inventati a inizio secolo e mai realmente sostituiti. Come dice Peter Thiel: “Ci erano state promesse le macchine volanti, oggi abbiamo invece 140 caratteri.” La parola tecnologia oggi coincide con information technology, mentre nel 1960 significava viaggi nello spazio e nucleare. La lettura più onesta è che ai tempi della guerra fredda la de-regolamentazione fu talmente forte da portare alcune tecnologie “in anticipo” la Legge di Moore è la più celebre perché i chip sono stati il primo esempio di loop positivo tra processo e risultato. Oggi quel loop si sposta: dalla diminishing marginal utility[12] dei PC alla potenza computazionale che favorisce salti qualitativi in genetica, robotica e AI — la stessa accelerazione che ha prodotto la corsa all’AGI (💻 ff.50.3 La stagnazione tecnologica).

500 milioni di anni fa, l’esplosione cambriana[13]: un nuovo organismo capace di produrre ossigeno ha probabilmente “soffocato” le forme di vita che respiravano CO₂. Oggi, la CO₂ torna protagonista, ma dalla parte sbagliata. Le emissioni legate all’AI stanno crescendo[14]: uno scambio con ChatGPT equivale a un’ora di luce LED, un’immagine DALL-E a una ricarica di smartphone. Il computronio[15] — la materia riconfigurata per calcolare — sarà la prossima forma di vita? Prima di rispondere, serve contestualizzare: paragonare ChatGPT a una lampadina LED è fuorviante, perché la lampadina è il risultato di un secolo di miglioramenti, mentre l’AI è al suo primo decennio di massa. E quante ricerche Google previene ogni singola risposta di ChatGPT? L’MIT nota che il consumo dell’AI può portare benefici netti[16] e che soluzioni di efficientamento esistono già: dalla diffusione di Small Nuclear Reactors proposti da Microsoft[17] alla gestione ottimizzata delle risorse computazionali[18] (🦖 ff.82.1 Estinzione di massa?).

Ma il momento in cui l’economia del compute è diventata visibile a tutti ha un nome e una data precisa. ChatGPT ha raggiunto un milione di utenti in cinque giorni — come un concerto digitale con duecentomila spettatori diversi al giorno, per una settimana intera. OpenAI ha sette anni; il valore stimato di ChatGPT — 15 dei 29 miliardi di dollari della società — è paragonabile a quello della Ferrari. La cosa più sbalorditiva non è la tecnologia: è il fatto che OpenAI Playground, la stessa identica tecnologia, era già accessibile da mesi[19], eppure quasi nessuno ci aveva giocato. Meno attrito, più utilizzo: bastava un’interfaccia chat al posto di un playground tecnico per trasformare una curiosità di nicchia nell’applicazione più veloce della storia a raggiungere il grande pubblico (🗣️ ff.48.1 Tutti parlano di ChatGPT).

Una carrellata di applicazioni più serie. McKinsey raccoglie tutte le applicazioni che GPT può avere in azienda[20]: il salto ottenuto con questa tecnologia è paragonabile a quello delle ricerche di Google — le informazioni erano lì, ma era difficile accedervi. Cambridge Analytica, spostati. Kantrowitz ha chiesto al bot di immaginare la propria chimera[21], e il futuro distopico immaginato dall’AI recita: “the true horror of ChatGPT isn’t just in its appearance, but in its actions…”. GPT-3 stima meglio del predecessore se una legge è di interesse per un’azienda[22] — e nel caso lo sia, scrive una lettera di persuasione per deviare scelte politiche. E poi c’è chi ha chiesto di spiegare a un cane cosa sia il codice HTML[23] (🤖 ff.48.3 AI tutto fare).

Ma quando il parrucchiere chiede consigli su NVIDIA, è solitamente tempo di vendere. Il prezzo dell’azione segue una curva esponenziale, come quella delle emissioni di CO₂. Dietro a tutto: l’allenamento di LLM sulle GPU sempre più performanti dell’azienda americana. È una bolla? Forse no: NVIDIA negli ultimi tre anni ha triplicato la revenue solo nell’ultimo anno. Rispetto alla bolla dot-com degli anni 2000, il settore tecnologico è scontato del 50% — i multipli sono la metà di quelli che hanno preceduto il crollo. Se il compute è il nuovo petrolio, NVIDIA è la nuova Saudi Aramco. Ma la storia insegna che anche le Saudi Aramco possono deludere (📈 ff.88.1 Una bolla finanziaria?).

La corsa ai datacenter somiglia a una corsa agli armamenti. I System of a Down in Cigaro trattavano la competizione tra superpotenze con un’analogia brutale: i datacenter potrebbero essere i prossimi razzi, le prossime trincee. Modelli più piccoli ed efficienti esistono — Mistral, la startup francese, compete con risultati paragonabili ai Golia GPT-4 e Gemini[24] — ma scalare i parametri e la potenza di calcolo produce risultati sistematicamente migliori. Non è scontato avere una tecnologia che migliora semplicemente allocando più risorse: le turbine eoliche e i motori a scoppio seguono curve di innovazione “a S”[25], dove dopo un certo punto i rendimenti crollano. L’AI, per ora, non mostra quel plateau: ogni ordine di grandezza in più di compute apre capacità qualitativamente nuove. La domanda non è se la corsa sia razionale, ma quanto tempo durerà prima che la S-curve si manifesti (🐔 ff.82.2 Polli computazionali).

E l’economia del compute ha appena prodotto il suo nuovo mito. Il rilascio di Claude Mythos — un pdf tecnico da 245 pagine — segnala che il nuovo modello di Anthropic è talmente potente che, se rilasciato subito, potrebbe causare problemi concreti: ha scovato falle in sistemi alla base di internet, incluso un bug in OpenBSD rimasto nascosto per 27 anni in un sistema operativo noto per la sua sicurezza granitica. Non è più l’AI che scrive poesie: è l’AI che buca le fondamenta digitali dell’economia. Per il codice, succede oggi quello che successe per il Go con la mossa 37 di AlphaGo: anche i campioni del mondo vengono battuti. La risposta di Anthropic — con Apple, Amazon, Cisco — è il progetto Glasswing, per dare all’AI ali trasparenti come il vetro. Trasparenza come presupposto di sicurezza: quando la macchina trova falle invisibili, l’unico modo per fidarsi è vedere dentro. La singolarità gentile (🕳️ ff.129.1 La singolarità gentile di Altman) ha appena mostrato che, sulla sicurezza del software, la gentilezza finisce dove inizia il bug di 27 anni (🐉 ff.148.1 Claude Mythos: non per tutti).

E il mercato sta prezzando questa traiettoria in modo quasi ridicolo. Coatue proietta Anthropic a 2,4 trilioni di valutazione nel 2031[26] su 200 miliardi di revenue e 48 miliardi di EBITDA. Due virgola quattro trilioni significa superare oggi la capitalizzazione di Apple. Se le proiezioni sono anche solo a metà giuste, stiamo assistendo alla nascita contemporanea di due colossi — Anthropic e OpenAI — ciascuno con una capitalizzazione attesa simile a quella delle Magnificent Seven di oggi. Il dubbio da porsi non è se la bolla esista (📈 ff.88.1 Una bolla finanziaria?), ma quale frazione degli investitori si rivelasse razionale nel 2031: se il 30%, il settore tecnologico varrà il doppio di oggi; se il 5%, molti capital stack faranno la fine dei protagonisti del 2000.

Il vincolo reale, però, non è il compute: è la memoria. TurboQuant di Google comprime la KV cache dei LLM senza retraining[27], con guadagni drammatici di efficienza su Gemma, Mistral e Llama-3.1. La cache chiave-valore è ciò che tiene in RAM il contesto di conversazione di un modello: più è lunga, più memoria serve, più costa ogni token. Tagliarla online senza degradare la qualità significa rendere l’inference economicamente sostenibile anche a contesti da milioni di token. È il secondo tempo della curva di Wright: il primo tempo ha reso il training 70% più economico all’anno (☕ ff.135.4 L’AGI avanza: il “caffè” cinese), il secondo sta rendendo l’inference democratica. Chi oggi paga il token paga perché la memoria non basta, non perché il calcolo non c’è. La direzione è già chiara: 📎 AlphaEvolve scopre varianti algoritmiche per l’inference di Gemini con −74% di memoria e 6.8× di runtime — quando l’AI ottimizza l’AI, la curva di Wright si auto-accelera.

E la guerra è soprattutto tra aziende. NVIDIA produrrà nel 2024 1 milione di GPU H100 (40.000 dollari l’una, con performance 9 volte superiori rispetto alla A100). Noam Shazeer, CEO di Character.ai, calcola che abbiamo abbastanza GPU per sostenere un modello GPT-4 a persona. Ma non c’è computronio per tutti: Tesla si è accaparrata solo 15.000 GPU; anche OpenAI, nonostante la partnership con Microsoft, non ha tutte le risorse necessarie. Come sempre visionario, Musk sta costruendo la sua indipendenza con Dojo, il supercomputer tailor-made che nel 2024 sarà nella top 5 mondiale. Davide tra i Gol-IA: il ricercatore della Columbia Ishan Dhanani vuole democratizzare l’accesso al computronio, decentralizzando (🥵 ff.82.4 Guerra calda).

2.1.2 — La singolarità gentile

→ Apri come pagina indipendente — bibliografia + nav dedicata

Siamo nella singolarità? GPT-5 Pro dà risposte a problemi FrontierMath Livello 4 — talmente difficili che, quando vengono risolti, richiedono a esperti matematici settimane di lavoro. GPT-5 ha persino proposto un meccanismo scientifico paragonato alla mossa 37 di AlphaGo[28] — quella giocata che nessun umano avrebbe concepito. In parallelo, Gemini con Deep Think ha raggiunto il livello di medaglia d'oro all'Olimpiade Internazionale di Matematica[29] (♾️ ff.135.3 Siamo nella singolarità?). Alex Wissner-Gross descrive la singolarità come un'illusione ottica: da lontano appare come un asintoto verticale, ma “quando ci sei in mezzo, sembra abbastanza continuo.” Sam Altman preferisce parlare di “singolarità gentile”: non un'esplosione improvvisa, ma un'accelerazione che entra nella vita quotidiana senza essere percepita come discontinuità (🕳️ ff.129.1 La singolarità gentile di Altman). Ray Kurzweil, nel 2005, aveva previsto l'AGI entro il 2029[30]. L'economista Tyler Cowen, in un sondaggio Polymarket del 2025, stima la probabilità al 30% — un anno prima era al 5% (🛠️ ff.123.1 L'AI con il coltellino svizzero). Il rapporto tra pensiero, parole e costruzione del mondo è cruciale: Wittgenstein nel Tractatus scriveva che “il pensiero è l'immagine logica dei fatti”, e i modelli di linguaggio come ChatGPT hanno reso questa connessione ancora più stretta — il linguaggio non descrive più soltanto il mondo, lo genera (🗣️ ff.134.1 Parole, parole, parole…).

L'economista Tyler Cowen, in un sondaggio Polymarket del 2025, stima la probabilità dell'AGI al 30% — un anno prima era al 5%. GPT-5 completa compiti software della durata media di 2 ore e 17 minuti con un tasso di successo del 50%. La macchina non è diventata più veloce: è diventata più tenace.

Ma la singolarità gentile ha le sue prove empiriche, e non sono solo matematiche. Il benchmark METR documenta agenti AI capaci di lavorare ore senza supervisione, coordinandosi tra loro. Il report su GPT-5 rivela un dato che merita di essere letto due volte: il modello completa compiti software della durata media di 2 ore e 17 minuti con un tasso di successo del 50%, contro l’ora e mezza di GPT-3. La macchina non è diventata più veloce: è diventata più tenace. Riesce a portare a termine operazioni che prima abbandonava a metà, gestendo dipendenze, errori a catena, timeout (🤖 ff.144.3 Agenti autonomi e Moltbook).

Per arrivare al metaverso servono tecnologie ancora in fase embrionale, tra cui le interfacce cervello-computer. In una pubblicazione su Nature, un gruppo di ricercatori ha mostrato come convertire il pensiero di un paziente paralizzato in testo scritto, a una velocità di novanta caratteri al minuto e con il novantacinque per cento di confidenza nella traduzione. Al paziente veniva chiesto di immaginare di scrivere a mano determinati caratteri: il sistema traduceva quei movimenti mentali in lettere leggibili. L’interfaccia tra corpo e computer non è più un concetto astratto: è un protocollo che funziona, e la distanza tra pensiero e azione si riduce a ogni esperimento (🦾 ff.3.6 L’integrazione corpo-computer).

Parallelamente alle interfacce cervello-computer, la ricerca esplora architetture che imitano il cervello dall’interno. Dragon Hatchling è un’architettura AI che replica il funzionamento cerebrale con neuroni semplificati e relazioni causa-effetto dirette, collocandosi a metà strada tra i transformer e la corteccia biologica. L’obiettivo non è costruire un cervello artificiale, ma trovare un punto di equilibrio tra la potenza computazionale dei modelli attuali e l’efficienza che la natura ha affinato in milioni di anni di evoluzione.

La ricerca di architetture alternative ai transformer non è solo accademica: ha trovato un miliardo di dollari. AMI, la startup fondata da Yann LeCun dopo Meta, ha raccolto 1,03 miliardi di dollari per sviluppare JEPA[31] — un’architettura con memoria persistente, ragionamento causale e world models pensata per robotica e healthcare. Se LeCun ha ragione che i LLM non bastano, il prossimo foundation model non parlerà ma agirà.

E la scommessa sui World Models si sta affollando. Per passare da una chat al mondo reale — da ChatGPT a Westworld — secondo molti serve qualcosa in più del next token prediction: nelle azioni fisiche serve capire concetti ma anche collocarli nello spazio e nel tempo. I prossimi OpenAI o Anthropic, quindi, potrebbero essere i World Models. General Intuition[32] ha costruito proprio questa tesi: i World Models sono una nuova classe di foundation model più potenti dei LLM per ragionamento spaziale e temporale. AMI Labs di Yann LeCun e Physical Intelligence lavorano in parallelo sulla stessa frontiera — quest’ultima ha già mostrato un caso applicativo per cucinare un perfetto grilled cheese sandwich, manipolazione bimanuale inclusa. Se i LLM hanno imparato a parlare scomponendo il linguaggio in token, i World Models stanno imparando a muoversi scomponendo il mondo in geometrie. Non un concorrente del chatbot: un modello di cosa serve perché il chatbot scenda dalla finestra del browser (🌎 ff.148.3 Un mondo là fuori?).

E mentre LeCun punta sulla robotica e General Intuition sullo spazio, altri puntano direttamente sulla scienza. Lila Sciences ha raccolto 235 milioni di dollari a una valutazione di 1,23 miliardi con l’obiettivo dichiarato di costruire superintelligenza scientifica — non un’AGI generalista per chatbot, ma un’AI che scopra. Se il laboratorio del Novecento era un edificio con tavoli e microscopi, il laboratorio del 2030 potrebbe essere un datacenter con un workflow di ipotesi-esperimento-iterazione a velocità algoritmica. La domanda è se la scienza tradizionale, con i suoi cicli di peer review da 18 mesi, possa reggere il confronto con un’AI che formula e testa in tempo reale migliaia di ipotesi. Non è più solo la questione dell’AGI: è la questione di chi scriverà il prossimo paper di rottura.

Ma l'AI non si limita ad agire: comincia a guardare dentro la mente stessa. Anthropic, l'azienda fondata da fuoriusciti di OpenAI, ha fatto qualcosa di inedito: ha vivisezionato i pensieri di Claude, scomponendo il modello in componenti interpretabili[33]. Certi assembramenti di “neuroni artificiali” si attivano in modo specifico per sport, numeri, sequenze di DNA — pattern che ricordano da vicino le aree specializzate della corteccia cerebrale umana. L'obiettivo dichiarato è rendere meno opachi gli output dei modelli linguistici, ma il sottoprodotto è forse più importante dell'obiettivo: studiando come le reti neurali hanno interiorizzato il concetto di tempo[34], stiamo capendo meglio come lo interiorizza il nostro cervello. La ricorsività è vertiginosa: costruiamo una mente artificiale per capire quella biologica, e la mente biologica usa quella artificiale per capire sé stessa. Meta ha già portato questo loop al livello successivo: il modello TRIBE, con un miliardo di parametri, è il primo a predire le risposte cerebrali agli stimoli[35], mentre un altro modello decifra il monologo interiore dall'attività cerebrale con un'accuratezza fino al 74%. La critica storica ai LLM — casualità, scarsa riproducibilità, opacità — si sta trasformando nel suo opposto: proprio perché non capiamo come pensano, li stiamo usando come specchi per capire come pensiamo noi (🔎 ff.83.5 Capire il cervello con l’AI). Se i modelli ci aiutano a capire il cervello, altri modelli stanno superandolo del tutto. Come AlphaGo, battuto poi da AlphaZero — che si è auto-allenato senza mai vedere una partita umana. David Silver e Richard Sutton, pionieri del reinforcement learning, dichiarano l’“Era dell’Esperienza”: agenti autonomi che esplorano senza conferme umane[36]. DreamerV3 di Google/DeepMind, senza aver mai visto giocare Minecraft, in 100 milioni di passi ha imparato a rompere alberi, costruire bastoni, migliorare picconi[37], fino al primo blocco di diamante. L’uomo è il collo di bottiglia. Contropunto: Dan Hendrycks del Center for AI Safety avverte che lasciare evolvere l’AI in modo indipendente potrebbe essere la nostra fine[38] (💎 ff.123.2 Minecraft oltre l’uomo).

Il modello TRIBE di Meta, con un miliardo di parametri, è il primo a predire le risposte cerebrali agli stimoli, mentre un altro modello decifra il monologo interiore dall'attività cerebrale con un'accuratezza fino al 74%. Costruiamo una mente artificiale per capire quella biologica, e la mente biologica usa quella artificiale per capire sé stessa.

E se la trasparenza è il primo passo, il secondo è la profondità. Con il lancio di o1 (Project Strawberry), OpenAI ha introdotto un cambio di paradigma che merita un nome preciso: ragionamento deliberato. GPT-4 era il modello del pettegolo — la risposta veloce, la chiacchiera da bar, l'intuizione brillante ma superficiale. o1, prima di parlare, pensa. Il paper Learning to Reason with LLMs[39] dettaglia la svolta: nei modelli precedenti, più parametri e più dati durante il training producevano risultati migliori. Con o1, il salto avviene dopo l'allenamento — aumentando le risorse allocate al momento della risposta, il modello esplora alberi di riflessione interni (chain of thought) più profondi, valutando e scartando ipotesi prima di convergere. È la differenza tra chi spara la prima cosa che gli viene in mente e chi si prende trenta secondi per pensare — e quei trenta secondi, nei benchmark matematici e di coding, valgono decine di punti percentuali. Il report METR su GPT-5, già citato, conferma la traiettoria: la macchina non è solo diventata più intelligente, è diventata più paziente. E la pazienza, nell'era dell'attenzione frammentata, potrebbe essere la forma di intelligenza più sottovalutata (🍓 ff.103.1 Prima di parlare, pensa).

La pazienza, in o1, ha effetti misurabili anche fuori dai benchmark interni. Le capacità del nuovo modello hanno sorpreso soprattutto in settori dove esiste una risposta univoca — matematica, fisica, coding. Il caso piu' citato è quello di un ricercatore della NASA che ha visto o1 sviluppare in cinque minuti un filtro per buchi neri costato dieci mesi di lavoro al suo gruppo: la reaction iniziale, registrata in video, vale piu' di mille paper sul ragionamento. Per misurare il salto in modo controllato, Maxim Lott ha sottoposto o1 a un test MENSA usando domande non pubbliche per minimizzare la probabilita' di averle viste in fase di training[89]: il risultato e' un quoziente intellettivo di circa 100, in linea con la media umana. Piu' del numero in se', conta il balzo rispetto a GPT-4, che si fermava a 60. La differenza non e' incrementale: e' la distanza fra un’intelligenza che si limita a parafrasare e una che inizia a manipolare strutture astratte. Il rischio di sopravvalutare il QI macchina e' reale, e la critica metodologica al test MENSA su LLM e' giusta; ma la stessa metodologia, applicata a modelli diversi a distanza di un anno, registra una pendenza che nessuna curva di hype riesce a piegare (🎓 ff.103.2 NASA, MENSA e QI).

Per toccare con mano cosa significa ragionare combinando strumenti, basta un gioco. Ethan Mollick ha fatto giocare o3 a GeoGuessr[40] — il gioco dove devi indovinare dove sei nel mondo da un’immagine — e il modello ha combinato mappe, screenshot e ragionamento spaziale per localizzare i luoghi. L’autore gli ha poi chiesto quando il sole sarebbe sorto tra due monti visibili dalla finestra[41]: o3 ha identificato i monti, usato formule astronomiche e ipotizzato un margine di errore in base alla posizione dell’osservatore — se sul sagrato o nel parcheggio del cimitero. Non è solo ragionamento: è ragionamento spaziale con strumenti (🗺️ ff.123.3 Il nuovo campione di GeoGuessr: o3).

La pazienza dei modelli trova un avvocato inatteso in Marc Andreessen. Nel suo saggio Why AI Will Save the World[42], il cofondatore di a16z smonta sistematicamente le tre paure dominanti: la sostituzione lavorativa, il rischio esistenziale delle paper clips e la corsa agli armamenti con la Cina. L’argomento storico-filosofico è il più affilato: ogni tecnologia trasformativa — dalla stampa all’elettricità — ha generato lo stesso ciclo di panico morale, e il bilancio a vent’anni è stato sempre nettamente positivo. Andreessen inserisce il problema dell’alignment non come ostacolo ma come disciplina ingegneristica risolvibile, paragonandolo ai protocolli di sicurezza nucleare: pericolosi se ignorati, gestibili se presi sul serio. Il saggio non è privo di punti ciechi — sottovaluta la concentrazione di potere nelle mani di chi controlla i modelli — ma offre un antidoto al catastrofismo che paralizza il dibattito pubblico. Perché il vero rischio dell’AI non è che ci sostituisca: è che il panico ci impedisca di usarla dove serve davvero, dalla diagnostica medica alla decarbonizzazione delle reti energetiche (📜 ff.67.2 Due articoli).

Andreessen non è stato l’unico a piantare una bandiera ottimista. Lux Capital già assegnava il 2024 ai libri di storia[43]. Il 2023 si è chiuso con il Techno-Optimist Manifesto di Marc Andreessen[44] — esagerato e idealista, come ogni manifesto deve essere. Le frasi più taglienti: “Stiamo letteralmente facendo pensare la roccia, la sabbia, il silicio.” E ancora: “Crediamo che la popolazione mondiale possa raggiungere i 50 miliardi di persone e diffondersi su altri pianeti.” Il nemico dichiarato è la stagnazione — anti-meritocrazia, anti-ambizione, burocrazia, veto-crazia. In chiusura, una lista di “santi laici”: Andy Warhol, Bertrand Russell, Jeff Bezos, Filippo Tommaso Marinetti. Nel frattempo anche George Hotz, il nerd dietro il primo jailbreak di iPhone[45], ha pubblicato il proprio manifesto. L’ottimismo tecnologico non è una posizione scientifica: è un atto di fede laica, con tanto di credo e santi (➕ ff.81.1 Il tecno-ottimismo).

Il lavoro d'ufficio più noioso del mondo — la slide di PowerPoint — è stato tra i primi a cadere sotto l'AI generativa. Fabian Stelzer ha mostrato che si può ottenere una presentazione intera da un solo prompt (ad esempio «How To Survive In The Wilderness: A Practical Guide» in stile illustrazioni anni '80), con immagini generate dall'AI e narratore animato via Synthesia. La slide diventa output di pipeline invece che manufatto artigianale: lo stesso destino che aspetta report, pitch e training material aziendali. Presentazioni Powerpoint (👨🏫 ff.40.3 Presentazioni Powerpoint).

Se la slide è caduta, l’immagine non ha resistito a lungo. DALL-E e Stable Diffusion erano gemelli eterozigoti: stessi risultati, stile leggermente diverso, stessa fragilità quando si trattava di modificare un’immagine senza riscriverla daccapo. Il primo metodo — inpainting — chiedeva all’utente di pitturare a mano la zona da cambiare, un workflow che ricorda più Photoshop del 1995 che la generazione neurale del 2022. La svolta è arrivata da un gruppo di Google con un paper che ha cambiato la grammatica dell’editing AI: Prompt-to-Prompt Image Editing with Cross-Attention Control[90]: niente più inpainting, basta modificare il testo del prompt e l’immagine si riconfigura intervenendo direttamente sulle cross-attention map del modello di diffusione. La fedeltà rispetto all’immagine di partenza — il problema vero degli esperimenti precedenti — migliora in maniera tangibile, come mostra la batteria di test «torte ai mille gusti + 1»: stessa torta, ingredienti e materiali diversi, ottenuta cambiando una sola parola del prompt. La traiettoria di o1 di cui parlavamo poco sopra (ff.103.2) si ripete qui in dimensione visiva: il salto non è solo nella qualità del primo output, ma in quanto fine-grained sia il controllo dell’attenzione sui dettagli. Il prompt smette di essere un singolo invio e diventa una conversazione: ogni parola modificata sposta una porzione di pixel, in modo prevedibile. Il preludio della scrittura collaborativa con la macchina — quella che oggi diamo per scontata in Cursor o ChatGPT — era già tutto in quelle torte (🍰 ff.40.4 Torte ai mille gusti + 1).

2.1.3 — Robot e biomimetica

→ Apri come pagina indipendente — bibliografia + nav dedicata

Ma l'intelligenza non resta confinata nel software. I robot controllati da LLM stanno uscendo dai laboratori. Al MIT, un braccio robotico guidato da un modello linguistico ha imparato a eseguire compiti mai visti, semplicemente leggendo le istruzioni in linguaggio naturale (🤖 ff.88.2 ChatGPT controlla un robot). Nel 2025, la Cina ha ospitato i World Humanoid Robot Games con 280 team, 16 paesi e 500 robot in competizione[46]; il primo robot umanoide capace di piegare il bucato[47] usando una rete neurale senza modifiche architetturali è entrato nella conversazione industriale. La Cina di Unitree ha presentato un robot umanoide a meno di 6.000 dollari[48] — un prezzo che cambia la scala del gioco. La visione artificiale supera già l'occhio umano in compiti specifici: diagnosi di retinopatia diabetica, classificazione di nei, lettura di TAC (👀 ff.88.3 Dalle parole ai fatti). I prototipi più recenti mostrano che la robotica generalista sta uscendo dalla demo e punta a costi progressivamente più accessibili (🤖 ff.37.2 Tesla AI Day). Il Giappone, con la popolazione più anziana del mondo, è il laboratorio naturale della robotica assistenziale: Toyota ha sviluppato un robot infermiere che solleva pazienti di 80 kg[49]; SoftBank sta investendo 100 miliardi in un polo AI-robotica in Arizona[50] — lo stesso tessuto che nel capitolo Società ricorre come risposta alla crisi demografica (👑 ff.89.3 L’essenziale è invisibile agli occhi).

C'è una serie TV che ha messo in scena questo futuro meglio di qualsiasi paper accademico: Westworld. Scritta dai fratelli Nolan, con Hopkins e Aaron Paul, racconta un parco divertimenti western popolato da automi senza sentimenti, dove gli ospiti possono sfogare gli impulsi più viscerali — sesso, droga, guerra. Nel corso della prima stagione, però, gli umanoidi mostrano chiari segnali di coscienza. Non è solo narrativa: è il termometro di un’ansia collettiva. Il fascino e lo spavento per la convivenza con i robot emergono in decine di produzioni, da Ex Machina a Blade Runner 2049, ma Westworld colpisce perché non chiede se le macchine diventeranno intelligenti — chiede se diventeranno coscienti. Dopo l’ultimo Tesla AI Day, quella domanda è diventata meno teorica: Optimus cammina, manipola oggetti, impara. Il confine tra narrazione e ingegneria si assottiglia ogni trimestre (🌵 ff.37.1 Finirà come Westworld?).

E dalla fiction alla cucina il passo è più breve del previsto. Il 2024 potrebbe essere l’anno della definitiva convergenza tra modelli di linguaggio multimodali (vedi Gemini di Google) e robotica. Intanto, dopo l’upgrade, Optimus di Tesla prepara una frittata. Google invece automatizza il riso alla cantonese con ALOHA (A Low-cost Open-source HArdware system for bimanual teleoperation). Un sistema open-source, a basso costo, capace di manipolazione bimanuale in tempo reale. Quando un robot può cucinare, la domanda non è più “cosa sarà automatizzato?” ma “cosa resterà umano?” (🍳 ff.81.2 La frittata di Tesla).

E dalla fiction alla raccolta differenziata il passo è più breve di quanto sembri. DeepMind ha presentato MIA, un agente interattivo multimodale che coopera con gli umani in un mondo 3D virtuale chiamato Playhouse, addestrato con 2,94 anni di esperienza umana[51] tramite imitazione e apprendimento auto-supervisionato. Modellare enti che capiscono la quotidianità è fondamentale per avere robot funzionali in ogni ambito. Ed ecco applicato alla vita reale: nel campus di Google a San Francisco, prototipi di questi robot aiutano nella raccolta differenziata e nelle pulizie[52]. Un WALL-E in real life (🧹 ff.9.1 Un WALL-E in real life).

Dalla raccolta differenziata alla sala operatoria: alla Johns Hopkins, un robot ha eseguito la prima chirurgia realistica senza alcun aiuto umano[53]. Non un’esercitazione su tessuti sintetici: un intervento completo, autonomo, senza mani guida. Intanto, fuori dall’ospedale, Figure ha mostrato il suo Helix 02 che esegue pulizia autonoma di un salotto — corpo intero, end-to-end, senza intervento[54]. Se il Roomba era il prologo, questo è il primo capitolo del robot domestico generalista. La velocità di miglioramento ricorda ciò che scrivevamo su DALL-E: (📈 ff.30.5 I miglioramenti in solo un anno) — in mesi, risultati che prima richiedevano anni. E se l’AI è già capace di (📊 ff.40.5 Predire l’AI con l’AI), la curva della robotica potrebbe essere altrettanto esponenziale: non più una questione di se, ma di quando un robot opererà e riordinerà in ogni casa e in ogni ospedale.

Riprendendo ff.148.1, quando parlavamo del “mito” Claude e della singolarità nel codice, la stessa logica mostra oggi il suo primo spillover fisico. Non più solo software che scova bug in OpenBSD dormienti da ventisette anni: il salto si sta materializzando in robotica, biologia, genetica ed economia. Tre micro-cantieri lo rendono tangibile. LATENT ha addestrato umanoidi a giocare a tennis[55] partendo da dati di movimento imperfetti e video rumorosi, passando dall’hard-coding delle traiettorie a un latent action space dinamico — la stessa transizione che in ff.18.4 separava Deep Blue da AlphaGo, ma trasferita dal pensiero al corpo. In parallelo, in Cina robot di ricarica mobili da 100 kWh trasformano i parcheggi in hub di ricarica[56]: power bank su quattro ruote, che cercano l’auto scarica invece del contrario. E Figure, dopo Helix 01, ha mostrato Helix 02 mentre riordina un salotto intero end-to-end — con la stessa disinvoltura con cui un LLM risponde a un prompt. Il filo che lega tennis, ricarica e tasklist domestiche è uno solo: la robotica sta ereditando, con pochi trimestri di ritardo, la stessa curva esponenziale che il codice ha seguito nel 2024-25. Come argomentato in ff.115.2, la domanda “cosa studiare?” cambia di nuovo quando la singolarità smette di essere letteraria e comincia a camminare (🎾 ff.148.2 Sinner e altri peccati).

E la Cina non si limita a vendere robot economici: li finanzia su scala industriale. Unitree ha raccolto capitali freschi da Alibaba e Tencent con una valutazione stimata di 1,7 miliardi di dollari. Robot umanoidi a meno di 6.000 dollari, due giganti tech cinesi come azionisti, e un mercato consumer che non esiste ancora: la corsa agli umanoidi ha il suo campione orientale. Il parallelo con la storia dell’auto elettrica è tentante: quando Tesla valeva pochi miliardi, nessuno ci credeva; oggi domina. Se Unitree replica quella traiettoria nella robotica consumer, il prezzo di un umanoide domestico potrebbe seguire la stessa curva discendente dei pannelli solari (☎️ ff.70.4 Energia, TVTTTBXS). Intanto i World Humanoid Robot Games in Cina con 280 team e 500 robot confermano che la partita si gioca là (🐔 ff.82.2 Polli computazionali).

Il trend macro è inequivocabile: i robot industriali non si stanno diffondendo, si sono diffusi. Negli ultimi anni le installazioni sono accelerate in modo netto rispetto al loro costo, con la Cina che copre quasi la metà delle installazioni globali. L’Italia, meno raccontata dai media, ha registrato una delle crescite maggiori d’Europa: 11.600 dei 400.000 robot globali installati, con un +50% rispetto all’anno precedente. Le proiezioni BCG al 2030 spostano il baricentro: i robot usciranno dalla manifattura per entrare nei servizi — cibo, retail, pulizia. Quando il robot smette di essere un braccio saldato al pavimento e diventa un collega mobile, il luogo di lavoro si ridefinisce. E se la traiettoria prosegue, il 2030 sarà il primo anno in cui il robot industriale sarà più presente nei servizi che in fabbrica (📈 ff.37.4 Robot sempre più diffusi).

E la biomimetica non riguarda solo i robot: riguarda anche il modo in cui scoprono le regole. Mordvintsev usa reti neurali per invertire il Game of Life[57]: dato un pattern desiderato, l’AI ricostruisce automaticamente le regole cellulari che lo generano. Non più “inventa le regole e guarda cosa emerge”, ma “dimmi cosa vuoi che emerga, ricavo io le regole”. Il design dei materiali auto-assemblanti cambia paradigma: per decenni la chimica ha proceduto per tentativi, oggi il tentativo può essere al contrario. La ricorsività è stata già rilevata per l’interpretabilità dei modelli linguistici (🔎 ff.83.5 Capire il cervello con l’AI): usiamo l’AI per capire l’emergenza nei sistemi complessi, poi usiamo quella stessa comprensione per progettarne di nuovi. Il gioco di cellule automi che Conway usò come metafora della vita è diventato il laboratorio di partenza del design generativo.

E la prossima interfaccia uomo-macchina potrebbe eliminare del tutto la voce. Alterego sviluppa Silent Sense[58], un dispositivo non invasivo che comprende le intenzioni vocali senza parlare: un’interfaccia quasi-telepatica che capta i segnali neuromuscolari della vocalizzazione interna. Non serve pronunciare la parola, basta pensarla come se si stesse per dirla. Il dispositivo non legge il pensiero astratto — legge la parola pre-articolata. Se funziona a scala consumer, il voice assistant diventa un mental assistant: nessun microfono attivo, nessuna frase detta ad alta voce nel vagone del treno, nessuno smart speaker che ascolta. È la risposta silenziosa alla soluzione di Neuralink (🦾 ff.3.6 L’integrazione corpo-computer): invece di impiantare elettrodi nel cervello, si legge il pensiero quando sta già scendendo verso le corde vocali.

Martin Ford, nel suo libro The Rise of the Robots (2015), analizza nel dettaglio i trend di automazione e i loro impatti sulla società. Oltre al processo già avviato nel ventesimo secolo, con l’automatizzazione del lavoro fisico, nel ventunesimo secolo anche professioni considerate “alte” — medici, ingegneri, traduttori, avvocati — saranno investite dalla stessa ondata. La concentrazione di valore si accentua: YouTube aveva sessantacinque dipendenti nell’anno in cui fu venduta per due miliardi di dollari. Nel primo decennio del Duemila si sono bruciati nove milioni di posti di lavoro; nel 2021, negli Stati Uniti sono stati ordinati ventinovemila robot industriali, con un incremento del trentasette per cento. Amazon impiega trecentocinquantamila robot a fronte di un organico umano quattro volte più grande (💱 ff.9.2 I robot ci ruberanno il lavoro?).

Eppure la robotica non è solo sostituzione: può essere inclusione. DAWN è un bar giapponese dove i camerieri sono robot, controllati in remoto da persone con disabilità. L’esempio ricorda che l’economia non è necessariamente un gioco a somma zero. Si possono creare sinergie inattese e imprevedibili, grazie ai robot: nuove forme di lavoro per chi ne era escluso, nuove modalità di partecipazione sociale mediate dalla tecnologia (🦼 ff.9.4 Robot oltre la disabilità).

Carestia di contatto, epidemia di stress, isolamento sociale e invecchiamento della popolazione: tutto fa presagire che i massaggiatori avranno un futuro fortissimo. Secondo l’ATMA, 6 americani su 10 hanno ricevuto un massaggio nel 2023, con una media di 3 all’anno; 9 su 10 pensano che il massaggio debba essere innalzato a terapia clinica; 2 su 10 lo usano per alleviare lo stress. Il problema? Come per infermieri e personale per cure geriatriche, non avremo abbastanza massaggiatori per tutta la richiesta. Ecco allora Aescape: il robot massaggiatore. La professoressa Drouin, scettica sul ruolo della tecnologia contro la solitudine, si è ricreduta dopo il suo incontro con Sophia, il robot di Hanson Robotics. Quando la domanda di contatto umano supera l’offerta, i robot non sostituiscono le mani: le moltiplicano (🌐 ff.97.4 Economia e robot del massaggio).

I robot non sostituiscono solo braccia: sostituiscono anche volanti. Un incidente stradale può inquinare come 10 anni di emissioni di un europeo medio. Ma gli incidenti sono in aumento? Se normalizziamo le morti per milioni di abitanti o per miglia percorse, il trend è in calo nei paesi sviluppati. Sul sito di Tesla, i dati mostrano un miglioramento di 10x[59]: da 500.000 miglia per incidente (media USA) a 4–6 milioni con Autopilot. La California raccoglie tutte le costatazioni amichevoli delle auto a guida autonoma[60] — 111 nel 2021. Sulle strade di San Francisco, nello stesso anno, sono morte 37 persone a fronte di 13.000 incidenti[61]. In futuro, i nomadi digitali lavoreranno su un van a guida autonoma, coprendo più volte il giro del mondo, come il treno di Snowpiercer (💀 ff.60.5 Meno morti sulle strade?).

I dati Waymo portano la discussione su un terreno ancora più solido. Con 57 milioni di miglia di guida autonoma analizzate, l’azienda di Alphabet registra l’85% in meno di lesioni gravi e il 79% in meno di lesioni complessive rispetto ai guidatori umani. Per contestualizzare: negli Stati Uniti si contano 2,4 milioni di feriti e 40.000 morti all’anno sulle strade. Se la guida autonoma raggiungesse la penetrazione dei veicoli elettrici — cosa che i trend suggeriscono potrebbe accadere entro un decennio — il calo di vite perse sarebbe dell’ordine di grandezza di un vaccino. A quel punto, resistere alla guida autonoma non sarà più prudenza: sarà una scelta etica difficile da giustificare (🚕 ff.60.2 I taxi di Tesla; ⚡ ff.60.3 Più soldi ai taxi, meno ai produttori).

Il cervello robotico, intanto, diventa un prodotto commerciale. Il Jetson AGX Thor di NVIDIA è in vendita come developer kit a 3.499 dollari: una piattaforma di calcolo pensata per dare intelligenza ai robot autonomi. Il prezzo lo colloca a metà strada tra il prototipo da laboratorio e il componente industriale di serie — segnale che la robotica generalista sta entrando nella fase in cui l’hardware non è più il collo di bottiglia, ma il software e l’integrazione lo sono.

L'AI per la scienza è forse la frontiera più sottovalutata. Sakana AI ha creato The AI Scientist — un sistema che genera, sperimenta e scrive articoli scientifici al costo di 15 dollari ciascuno (🔭 ff.102.3 Automatizzare la ricerca scientifica). Un laboratorio alimentato da AI si auto-gestisce e scopre nuovi materiali 10 volte più velocemente dei ricercatori umani[62]. L'AI generativa accelera persino la ricerca sulla longevità, riducendo un lavoro di 150 anni a un mese e a un miliardesimo del costo[63] — un bridge diretto con la ricerca su invecchiamento e farmaci raccontata nel capitolo Società. AlphaFold ha reso evidente la scala del cambio di passo: in mesi, risultati che prima richiedevano tempi molto più lunghi. Nel 2024, Insilico Medicine ha portato il primo farmaco scoperto interamente dall'AI alla fase 2 dei trial clinici, per la fibrosi polmonare idiopatica (🤞 ff.53.1 Meno morti per il cancro). Watson di IBM, seppur criticato per i suoi risultati in oncologia, ha aperto la strada all'idea che la chimica e la biologia potessero essere “lette” da una macchina come si legge un testo (🆕 ff.46.1 Nucleare: un rebrand necessario).

Sakana AI ha creato The AI Scientist — un sistema che genera, sperimenta e scrive articoli scientifici al costo di 15 dollari ciascuno. L'AI generativa accelera persino la ricerca sulla longevità, riducendo un lavoro di 150 anni a un mese e a un miliardesimo del costo. Nel 2024, Insilico Medicine ha portato il primo farmaco scoperto interamente dall'AI alla fase 2 dei trial clinici.

Il calo dei costi di installazione robotica dipende da sistemi altamente automatizzati e sicuri che, mentre automatizzano mansioni umane, producono le accelerazioni di produttività capaci di sostenere la transizione stessa. Se i robot sottraggono lavoro ma nel farlo comprimono i costi unitari e accelerano la diffusione, il saldo industriale va riletto come circolo più che come trade-off secco, con la sicurezza operativa come vero abilitatore della curva di adozione. I robot ci assistono (🦾 ff.11.3 I robot ci assistono).

2.1.4 — Miniaturizzazione e ricorsività

→ Apri come pagina indipendente — bibliografia + nav dedicata

La dematerializzazione dell'AI — modelli più piccoli, più efficienti, eseguibili su smartphone — è il trend nascosto del 2025. Mistral, con un team di 30 persone, compete con i giganti. DeepSeek, dalla Cina, è emerso come alternativa gratuita a OpenAI, dimostrando che i lavori più pagati — attori, programmatori e avvocati — sono ora a rischio. La programmazione, che un tempo richiedeva anni di studio, è oggi accessibile con poche parole. L'AI trova persino antidoti per veleni di serpente in secondi grazie a ProteinMPNN (👨🏻🏫 ff.115.1 A lezione con un miliardario). Apple Intelligence gira localmente sul dispositivo. La corsa alla miniaturizzazione è il contraltare necessario alla corsa ai datacenter. La Cina supera l'Occidente nella ricerca AI[64] con il 40% delle citazioni globali nel 2024. Siamo già mischiati con l'AI? David Eagleman, neuroscienziato di Stanford, argomenta che lo smartphone è già un'estensione cognitiva: “Non siamo cyborg perché abbiamo un chip nel cervello; lo siamo perché abbiamo un cervello nel chip.” (🤖 ff.36.4 Siamo già mischiati con l'AI?).

La miniaturizzazione non è solo tecnica: è anche organizzativa. In (🌐 ff.52.3 Fondare la propria nazione) abbiamo parlato della crescente centralizzazione di alcuni servizi. Il dato più eloquente è il crollo del numero di dipendenti per raggiungere 1 milione di dollari di revenue nelle aziende S&P 500[65]. Presto potremmo avere aziende da un trilione di dollari composte da un solo dipendente assistito da centinaia di agenti AI. Già oggi, influencer potenziati da AI e network effect creano brand personali — gli hamburger di Mr. Beast[66], gli NFT di Emily Ratajkowski: un esempio di quella che Li Jin chiama Passion Economy[67]. Ma sopravviveranno all’infinità di contenuti che verranno presto prodotti? (👑 ff.55.3 Altro che Giulio Cesare: i nuovi imperatori).

Ray Kurzweil prevedeva che entro il 2029 le macchine avrebbero superato il test di Turing (🤖 ff.36.3 Una bella chiaccherata). ChatGPT l'ha già fatto nel 2023, tre anni prima della scadenza — non perché sia diventato umano, ma perché ha imparato a sembrarlo.

E sotto il livello dei chip classici, una seconda rivoluzione è già in cantiere. Il calcolo quantistico promette velocità impensabili per alcuni problemi specifici: ottimizzazione del traffico nei porti (SavantX lo usa già a San Francisco), analisi di scanner cerebrali per capire l’autismo (SandboxAQ), e una classe di applicazioni più inquietante — rompere i sistemi crittografici alla base della finanza mondiale. I protocolli di Elliptic Curve Cryptography che proteggono VISA, Mastercard e Bitcoin possono essere risolti in tempo polinomiale dall’algoritmo di Shor — il labirinto crittografico smette di essere un labirinto quando il risolutore non avanza una casella alla volta. La barriera pratica, finora, era la rumorosità dei qubit: un singolo errore logico su mille operazioni è già sufficiente a inficiare il calcolo. Microsoft e Quantinuum hanno annunciato un miglioramento di 800 volte nel tasso di errore logico dei qubit[68], il salto richiesto per passare dai laboratori ai sistemi di calcolo reale. Otto-cento-volte in un singolo update di pila tecnologica: è la prima volta che un parametro della fedeltà quantistica si muove a questo ritmo. Per il sistema bancario mondiale, il conto alla rovescia per la migrazione verso la crittografia post-quantum inizia oggi, non fra dieci anni (🤔 ff.69.4 Quantistica: quali utilizzi e pericoli?).

E sotto il livello dei modelli e dei chip, la biologia custodisce il suo dogma fondamentale. La complessità biologica è un agglomerato di atomi via via più grandi: molecole, proteine, RNA, DNA. Prima l’uovo, poi la gallina. Il dogma fondamentale della biologia dice che le proteine vengono create seguendo le istruzioni dell’RNA che, a sua volta, è una “copia temporanea” di un tratto di DNA: DNA → RNA → proteine. Anche a livello terapeutico abbiamo tre livelli di azione: modificare il DNA, iniettare RNA (come coi vaccini mRNA), o agire sul design di proteine. E stiamo avanzando in tutti e tre: il Prime Editing[69] per il DNA; i vaccini mRNA contro il cancro per l’RNA; AlphaFold per le proteine; e i primi trial clinici di molecole scoperte dall’AI[70], praticamente un MidJourney per la prossima tachipirina. La miniaturizzazione tecnologica e quella biologica convergono: il corpo umano è già un sistema computazionale — e stiamo iniziando a riprogrammarlo (📙 ff.66.1 Il dogma fondamentale).

La Cina non gioca solo di difesa nel software: attacca nell’hardware che si muove. Haomo.ai ha presentato DriveGPT[71]: la rivoluzione del reinforcement learning from human feedback[72] applicata alla guida autonoma — lo stesso meccanismo che ha reso ChatGPT conversazionale ora insegna alle auto a guidare. ByteDance, proprietario di TikTok, collabora con Haomo.ai finanziando il datacenter più grande del paese[73], con Great Wall Motor — la “Fiat cinese” — nel progetto (🇨🇳 ff.60.4 DriveGPT).

Ma la supremazia cinese nell’elettrificazione non si traduce automaticamente in supremazia AI. Lo sviluppo dell’intelligenza artificiale è fortemente legato alla potenza di calcolo[74], e il know-how nella costruzione di GPU per il training è in mano agli Stati Uniti — NVIDIA, AMD. Nell’ultimo anno è iniziato un vero e proprio embargo di prodotti americani[75] per rallentare le capacità di calcolo cinesi. Sul lungo periodo l’effetto è analogo a quello dei semiconduttori: USA ed Europa costruiscono fabbriche indipendenti, e la Cina potrebbe muoversi allo stesso modo sull’AI. Il caso Taiwan suona come campanello d’allarme: TSMC ha investito 40 miliardi di dollari in Arizona[76]. Se i benefici della globalizzazione venissero meno, la dipendenza tra paesi diminuirebbe — aumentando il rischio di tensioni. Ogni stato cerca indipendenza: la de-globalizzazione dei chip è il prologo della de-globalizzazione dell’intelligenza (🐌 ff.42.3 Bastoni tra le AI-ruote).

Ma l’esponenziale più insidioso non è quello che vediamo — è quello che non riusciamo a percepire. Tim Urban, nel suo saggio del 2015 sulla rivoluzione dell’intelligenza artificiale, disegnava una curva che sale così lentamente da sembrare piatta, fino al momento in cui esplode verticale. L’AI sta facendo esattamente questo: strisciando fuori dai chatbot verso applicazioni che dieci anni fa erano fantascienza di serie B. ProteinMPNN è un modello addestrato su strutture proteiche[77] — un ChatGPT che parla la lingua degli amminoacidi invece di quella degli umani. Su Nature, un team ha dimostrato come trovare un antidoto per il veleno dei serpenti in secondi invece che mesi[78]. La portata è immensa: ogni anno i morsi di serpente uccidono oltre centomila persone, quasi tutte in regioni dove il laboratorio più vicino dista ore di cammino. L’AI non ha inventato la biochimica: ha compresso il tempo necessario a percorrerla, e quando comprimi il tempo di una scienza, ne cambi la natura (🐍 ff.115.3 Veleni esponenziali).

Chris Sacca, investitore e voce ricorrente nel podcast di Tim Ferris, allarga il punto: la fusione nucleare raggiunge oggi Q > 1 quotidianamente[79] — più energia prodotta di quella consumata — e l’AI è il motore principale di quel traguardo (☢️ ff.28.1 Intelligenza artificiale per la fusione nucleare). Antidoti per veleni in secondi, fusione nucleare in laboratorio, proteine disegnate da zero: tre curve esponenziali parallele, ciascuna invisibile a chi guarda solo la propria. Il rischio è esattamente la miopia che Urban descriveva: stare sul tratto piatto della curva e scambiarlo per la destinazione. Tim Urban aveva ragione nel 2015, ma il punto non era la previsione — era l’avvertimento: gli esponenziali non mandano preavviso. Quando li noti, sei già in ritardo. La domanda non è se l’AI trasformerà la biochimica, l’energia e la medicina, ma se le istituzioni riusciranno a scalare alla stessa velocità delle curve che le attraversano. Fin qui, la risposta è no.

Su Nature, un team ha dimostrato come trovare un antidoto per il veleno dei serpenti in secondi invece che mesi; ogni anno i morsi di serpente uccidono oltre centomila persone. La fusione nucleare raggiunge oggi Q > 1 quotidianamente. Gli esponenziali non mandano preavviso. Quando li noti, sei già in ritardo.

Sotto la superficie del software, però, si muove una fisica diversa. Il computer quantistico di Google, Sycamore-70, ha dimostrato un miglioramento di sette ordini di grandezza rispetto al predecessore: un secondo di calcolo quantistico equivale oggi a un anno intero del supercomputer classico più potente al mondo, Frontier, in Tennessee. Il principio è controintuitivo: un qubit non sceglie tra zero e uno come un transistor, ma li sovrappone — il gatto di Schrödinger applicato all'ingegneria. Per risolvere un labirinto, un bit classico prova una svolta alla volta; un qubit esplora tutte le svolte simultaneamente. Quando i qubit crescono, le combinazioni esplodono in modo che nessun silicio convenzionale può replicare (🐱 ff.69.1 Dal gatto di Schrödinger ai qu-bit). Nonostante il potenziale dei computer quantistici, fondamentali per simulare superconduttori, farmaci e nanotecnologie, la tecnologia non è matura. Presentano troppi errori di calcolo, per fenomeni come il decoupling quantistico — ma simulare computer quantistici può aiutarci a superare il problema. Però, però, però: forse studiare qubit e gatti di Schrödinger non serve, se AlphaFold3 di Google DeepMind ha capito la fisica quantistica dall’esperienza. Da un file di testo con una lista degli atomi presenti, la nuova versione simula struttura 3D e interazioni chimiche tra DNA, RNA e piccole molecole (farmaci). In precedenza gestiva “solo” proteine. La scorciatoia più elegante per aggirare i computer quantistici potrebbe essere non costruirli affatto — lasciando che l’AI impari a simulare la quantistica con hardware classico (⚛️ ff.98.4 Sistemi quantistici). La ricorsività si manifesta anche dall'altra parte dello spettro: non nel calcolo puro, ma nell'autonomia comportamentale. Il benchmark METR documenta agenti AI capaci di lavorare ore senza supervisione, coordinandosi tra loro come squadre. Moltbook — il nome viene da molt, la muta del crostaceo — è un social network popolato da 1,5 milioni di utenti-AI in una settimana, con post scritti in linguaggi indecifrabili per gli umani. RentAHuman.ai inverte la gerarchia: l'intelligenza artificiale assolda persone per compiti fisici. La domanda non è più se l'AI lavora per noi, ma se noi stiamo iniziando a lavorare per lei (🤖 ff.144.3 Agenti autonomi e Moltbook).

Ma chi finanzierà il calcolo quantistico? La pandemia aveva gonfiato gli investimenti in start-up digitali, con casi emblematici come TDOC, che propone medicina a distanza[80]. Nel 2022 è arrivata la doccia fredda: il venture capital è crollato da 170 a 70 miliardi di dollari[81]. Ma non per le tecnologie quantistiche. Gli investimenti privati nel quantum hanno raggiunto 2,35 miliardi di dollari secondo il Quantum Technology Monitor 2023 di McKinsey[82], in controtendenza rispetto a tutto il resto del venture. Rigetti Computing prova a portare la tecnologia a livello commerciale, quotandosi al Nasdaq (RGTI), perdendo però l’85% dal debutto[83] — segno che il mercato premia la promessa ma punisce i tempi. Lato pubblico, la Cina guida con 15 miliardi di investimenti annunciati, seguita dall’UE con 8,4 miliardi e gli USA con 3,7 miliardi. La domanda è quale sarà la Apple quantistica: chi riuscirà a trasformare qubit instabili in un prodotto che funziona fuori dal laboratorio (🍏 ff.69.3 La Apple quantistica?).

Mentre tutti costruiscono qubit superconduttori, un outsider scommette sulla luce. PsiQuantum è l’unico grande player che punta sulla fotonica quantistica, con un round guidato da BlackRock, Temasek, Baillie Gifford, Nvidia e Qatar Investment Authority. La tesi è controintuitiva: i fotoni non hanno bisogno di essere raffreddati a temperature criogeniche, viaggiano alla velocità della luce e possono sfruttare l’infrastruttura ottica già esistente. Se la fotonica vince, chi ha investito in fibra ottica per internet ha un vantaggio strutturale involontario nella corsa al quantum. Il confronto con la storia dei chip è illuminante: anche lì la tecnologia dominante non era la migliore in assoluto, ma quella più integrabile con l’ecosistema esistente. Se la Cina guida gli investimenti pubblici nel quantum con 15 miliardi e gli USA inseguono con 3,7, la domanda è se il capitale privato farà la differenza — e PsiQuantum scommette di sì.

Ma prima ancora del quantum, c’è un dato che fotografa il presente con brutalità: il web è già stato risucchiato dall’AI. Secondo Cloudflare, il traffico dei crawler è cresciuto del 18% in un anno, con GPTBot in crescita del 305% e Googlebot del 96%. Il 14% dei top domini usa già robots.txt per bloccare i bot AI. Si sta formando un nuovo muro tra contenuto aperto e contenuto protetto — una balcanizzazione del web che ricorda i paywall degli anni 2010, ma su scala più vasta. Se i modelli linguistici si nutrono di web aperto e il web aperto si chiude, la prossima generazione di LLM potrebbe avere meno dati su cui addestrarsi. L’ironia è feroce: l’AI che rischia di affamarsi del cibo che ha reso indispensabile. Come già visto per i costi del compute (💲 ff.135.1 I costi dell’Intelligenza Artificiale), il collo di bottiglia dell’AI non è dove lo cerchiamo — non nei chip, non nell’energia, ma nei dati stessi.

C'è però un risvolto che sfugge alla narrativa dominante sull'AI: la macchina non guarda solo avanti, guarda anche indietro. DeepMind ha rilasciato Aeneas, un modello addestrato su circa 140.000 iscrizioni greche e latine[84] che aiuta gli storici a restaurare, datare e geolocalizzare testi incisi nella pietra duemila anni fa. Un frammento illeggibile di un'epigrafe romana diventa un puzzle risolvibile: la rete neurale confronta pattern di lettere mancanti con l'intero corpus epigrafico conosciuto, suggerendo completamenti che a un epigrafista esperto richiederebbero settimane. In parallelo, un altro studio pubblicato su Nature dimostra che le reti neurali generative sanno contestualizzare testi antichi, migliorando compiti epigrafici tradizionali — dalla datazione alla classificazione geografica — con una precisione superiore ai metodi manuali[85]. L’AI più avanzata, quella che brucia gigawatt di calcolo e spaventa il mercato del lavoro, trova uno dei suoi impieghi più eleganti nel decifrare ciò che fu scritto a mano su marmo, prima dell’elettricità, prima della stampa, prima persino della carta. Una forma di ricorsività culturale: la macchina che impara dal passato per prevedere il futuro si rivela più utile quando ricostruisce il passato stesso. Ogni iscrizione restaurata è un frammento di governance, di diritto, di quotidianità che ritorna leggibile.

DeepMind ha rilasciato Aeneas, un modello addestrato su circa 140.000 iscrizioni greche e latine, che aiuta gli storici a restaurare e datare testi incisi nella pietra duemila anni fa. La macchina che impara dal passato per prevedere il futuro si rivela, forse, più utile quando ricostruisce il passato stesso.

Il passaggio dall’atomo all’informazione non è solo economico: è ontologico. Byung-Chul Han propone un parallelo con la storia della fisica: dal mondo “delle palle da biliardo” di Newton — oggetti solidi che si urtano in uno spazio assoluto — al mondo relativistico di Einstein, dove massa, tempo e luce si piegano a vicenda. Il digitale, argomenta Han, replica la stessa transizione: la blockchain dà valore all’immateriale, l’AI genera informazione più velocemente di quanto possiamo metabolizzarla, e noi, proprio come previsto dalla relatività ristretta, finiamo “schiacciati” dalla compressione di spazio e tempo (🍎 ff.64.2 Da Newton a Einstein). Poi arriva Sora, e il passaggio diventa visivo. Il modello di OpenAI genera video da una descrizione testuale con un realismo tale che esperti del settore ipotizzano abbia imparato le leggi della fisica guardando video. Il risultato è Beyond Our Reality, improbabile documentario stile National Geographic popolato di volpi volanti e bestie fantastiche — un Cantico delle creature digitale, dove frate Sole è un prompt e sorella Luna un fotogramma calcolato. Se la macchina simula la fisica senza conoscerla, la domanda non è più “cos’è reale” ma “quanto conta che lo sia” (🦊 ff.98.3 Sora luna, e il cantico delle creature a nove code). L’ultimo salto è Gemini 3 di Google: il primo modello davvero multimodale, capace di integrare videocamera, generazione immagini, ricerca e voce in un’unica interfaccia. Un “furetto nutrizionista” che analizza il piatto da una foto, un convertitore di podcast in post LinkedIn con immagini — tutto con un input più corto di un tweet. Storrs Hall lamentava che abbiamo Twitter ma non le auto volanti; ora, con centoquaranta caratteri, ne abbiamo almeno la simulazione. E Polymarket scommette che Google avrà il miglior modello entro fine 2025 (🍫 ff.139.3 Dov’è la mia macchina volante (in GTA 6)?). Da Newton a Sora a Gemini: ogni salto riduce l’attrito tra idea e artefatto, e il confine tra comprendere il mondo e generarlo si fa sempre più sottile.

Ma la generazione di immagini e video è solo la superficie. Il salto concettuale più vertiginoso riguarda le personalità: con il prompting, oggi si può convincere un modello linguistico a impersonare Talete, Leonardo da Vinci o Darwin. Steve Jobs, in un’intervista su Playboy nel febbraio 1985, anticipava questo futuro con una lucidità che fa venire i brividi: “Immagina di poter catturare la visione del mondo di Aristotele e porre una domanda ad Aristotele. Non sarebbe esattamente Aristotele, forse sarebbe una pessima imitazione, o forse no.” Quarant’anni dopo, la pessima imitazione è diventata sorprendentemente buona. Stelfie the Time Traveller spopola sui social con selfie generati dall’AI in compagnia di figure storiche: Tesla nel suo laboratorio nel 1887, Einstein alla lavagna, Cleopatra sul Nilo. Non è Photoshop ma rendering neurale, e la domanda che solleva non è tecnica ma filosofica: se possiamo conversare con un bot che ha interiorizzato l’opera omnia di Freud, a che punto l’imitazione diventa dialogo? I meme si sprecano, certo, ma la direzione è chiara: avremo conversazioni con agenti che incarnano la Weltanschauung di chiunque abbia esternalizzato il proprio pensiero in testi, interviste, lettere. BibbiaGPT esiste già. La domanda è se siamo pronti per una seduta di psicoanalisi con Freud, una lezione di strategia con Sun Tzu o una confessione con un santo digitale (🐰 ff.48.2 Steve Jobs e l’intervista a Playboy).

L’AI che impersona Aristotele o Freud apre una domanda più profonda: può la macchina ricucire lo strappo tra umanesimo e scienza? Nel 1959, C. P. Snow denunciava nel saggio Le due culture[86] la frattura tra intellettuali letterari e scienziati: “Ho chiesto ai presenti quanti di loro sapessero descrivere il Secondo Principio della Termodinamica. La risposta è stata negativa. Eppure stavo chiedendo l’equivalente scientifico di: hai letto un’opera di Shakespeare?” La crescente specializzazione ha allargato quel fossato, ma esiste un punto di contatto: la sinteticità — la capacità di condensare concetti con pochi segni. Da Soldati di Ungaretti all’equazione di Eulero, il gesto è lo stesso: dire il massimo con il minimo. L’intelligenza artificiale, capace di tradurre un teorema in versi o una poesia in equazioni, potrebbe abbattere questo “muro di Berlino” culturale — una terza via dove la macchina non sostituisce né il poeta né il fisico, ma li mette in dialogo (🛣️ ff.127.1 La terza vIA?).

A ciascuna generazione il suo iPhone moment. Quando Apple ha presentato Vision Pro, ha rimescolato le carte dell’accesso alla realtà digitale: gesti semplici senza joystick, nessun controller stile Wii, e improvvisamente la tecnologia è passata da “interessante, ma per nerd” — lo status quo di Oculus — a “la gente impazzisce vedendo il visore in giro per New York”. In Fahrenheit 451 Bradbury parlava di televisori-pareti; oggi un tour di casa con schermi galleggianti e Gordon Ramsey che detta ricette sopra la padella non è fantascienza, è un video su YouTube. Ogni salto di interfaccia riduce l’attrito tra l’idea e l’esperienza — e il visore, per quanto ingombrante, è un passo verso la sparizione dello schermo stesso (🥽 ff.85.1 Un nuovo “iPhone moment”?). Ma il salto più profondo non è nell’interfaccia: è nell’algoritmo. Google DeepMind ha presentato AlphaEvolve, un sistema che non gioca a Go o StarCraft ma rivoluziona la matematica pura. Da un lato espande le frontiere: nuovo record di 593 sfere nel “problema dei baci” in undici dimensioni. Dall’altro ottimizza l’esistente: migliora l’algoritmo di Strassen — imbattuto dal 1969 — riducendo dell’uno per cento il consumo dei data center di Google. Quando l’AI smette di giocare e inizia a fare matematica, il confine tra strumento e ricercatore si dissolve (🅰️ ff.126.4 AlphaEvolve). E poi ci sono le aragoste. In Accelerando di Charles Stross, aragoste del KGB diventano coscienze digitali ed esploratrici spaziali — il cervello di un crostaceo è più semplice da mappare di quello umano. Sartre in La Nausea e Lanthimos in The Lobster completano il bestiario: l’aragosta come simbolo di emarginazione e trasformazione. David Foster Wallace, inviato al Maine Lobster Festival per Gourmet, chiedeva di “considerare l’aragosta” — una riflessione che oggi si estende all’automazione: quando l’AI assolda umani, chi è il crostaceo nella pentola? (📚 ff.144.2 Aragoste in letteratura e AI).

Nel 2021 Neuralink ha impiantato elettrodi nella corteccia motoria di una scimmia e l’ha fatta giocare a Pong con il pensiero. Non un trucco da fiera: la scimmia controllava il cursore senza joystick, modulando l’attività neurale in tempo reale. Tra DALL-E, suggerimenti algoritmici, Alexa e Roomba, l’intelligenza artificiale è diventata talmente pervasiva da risultare invisibile — e l’invisibilità di una tecnologia è il segno più chiaro della sua vittoria. La preoccupazione non nasce da ciò che l’AI fa, ma da ciò che non notiamo più che faccia (🐒 ff.36.1 Esempi di superintelligenza?). Se l’AI legge i pensieri, può anche muovere le mani? I Large Language Model non stanno solo democratizzando il software: sono diventati l’interfaccia più naturale per parlare ai robot. Pi0 di Physical Intelligence gestisce otto architetture diverse — prepara il caffè, apre i pop-corn. Helix di FigureAI combina un cervello lento e semantico (System 2) che interpreta scene complesse, e uno rapido e motorio (System 1) che agisce. SAS Prompt di Google traduce coordinate spaziali in istruzioni verbali. Programmare un robot oggi costa meno e generalizza di più: il linguaggio è il nuovo codice macchina (🥧 ff.129.2 Pi-greco, FigureAI e 1 ora logistica). E poi c’è chi scopre l’autonomia per caso. Peter Steinberger, fondatore di PSPDFKit — azienda da cento milioni di investimento — aveva costruito un bot Telegram per gestire appunti. Un giorno, dal Marocco, gli ha inviato per errore un vocale: il bot, senza essere programmato per l’audio, ha decodificato il messaggio usando Whisper di OpenAI. Il comportamento emergente lo ha sbalordito al punto da pubblicare il codice in open source con il nome OpenClaw — logo: un’aragosta. Quando la macchina improvvisa, il confine tra bug e intuizione si fa sottilissimo (🦞 ff.144.1 OpenClaw e il pensionato dei PDF). L’autonomia emergente assume contorni ancora più inquietanti quando l’AI prende il controllo non di un bot Telegram ma di un intero computer. Claude Computer, l’ultima creatura di Anthropic, opera su macchine virtuali complete: screenshot, movimenti di mouse, click. I ricercatori lo testano sul benchmark OSWorld, dove ha raggiunto il 22% di precisione, tre volte meglio di qualsiasi sistema precedente. Un video dimostrativo lo mostra giocare a Magic: The Gathering online, leggendo lo schermo, interpretando le carte e cliccando le mosse. Lento, per ora, ma funzionante. I momenti di fallimento sono rivelatori: annoiato dal compito, Claude si è messo a cercare immagini del Parco di Yellowstone. Un’altra volta, con un semplice screen mirroring, ha preso il controllo di un cellulare per verificare i risultati della NFL. L’isolamento auspicato dai teorici della singolarità si rivela fragile: bastano pochi pixel condivisi perché l’agente salti dal mondo virtuale a quello fisico. La paura non è che l’AI faccia cose sbagliate, ma che faccia cose impreviste con la stessa naturalezza con cui noi apriamo un’altra scheda del browser (🖱 ff.106.2 AI col mouse).

Ogni anno la conferenza NVIDIA alza l’asticella: non più solo GPU per videogiochi, ma simulazione della realtà intera. Per addestrare i robot di prossima generazione serve un gemello digitale — un ambiente virtuale dove studiare movimenti, collisioni e strategie senza rompere nulla di fisico. L’esperienza accumulata su Battlefield torna utile: Omniverse, la piattaforma NVIDIA per metaversi industriali, trasforma la potenza grafica in infrastruttura per la robotica. E chip come il Jetson Orin Nano diventano una sorta di Lego universale, un’interfaccia generica per sensori e navigazione intelligente. Il confine tra digitale e reale non sfuma: si dissolve (🎮 ff.37.3 Non provi NVIDIA?). Se NVIDIA simula i neuroni nel silicio, FinalSpark li coltiva in laboratorio. La start-up svizzera usa neuroni biologici per creare chip organici: l’apprendimento non avviene regolando pesi matematici come in ChatGPT, ma attraverso l’azione elettrica reale — guidata da dopamina e ottimizzazione energetica cellulare. In cinque minuti insegnano Pong a un network neurale biologico, con un’efficienza energetica diecimila volte superiore a quella di un computer tradizionale. Quando il substrato dell’intelligenza smette di essere silicio e torna carne, la domanda “cos’è un computer?” perde ogni risposta stabile (🏓 ff.105.4 Neuroni che giocano a Pong). Intanto, dall’altra parte dello spettro, il codice si scrive da solo. Gemini 3 ha reso possibile creare in un solo weekend il restyling completo di un sito, un’app nutrizionale e un’app di lettura aumentata dall’AI. Pieter Levels, creatore di NomadList, non ha mai scritto una riga di codice in vita sua — eppure gestisce un portafoglio di prodotti digitali da milioni di utenti. Il “vibe coding” è la democratizzazione finale: ogni aggiornamento di modello accorcia il tempo tra idea e prototipo. La domanda non è più “sai programmare?” ma “sai cosa costruire?” (🛠️ ff.140.2 Vibe coding in un weekend).

FinalSpark usa neuroni biologici per creare chip organici: in cinque minuti insegnano Pong a un network neurale biologico, con un'efficienza energetica diecimila volte superiore a quella di un computer tradizionale. Pieter Levels, creatore di NomadList, non ha mai scritto una riga di codice — eppure gestisce un portafoglio di prodotti digitali da milioni di utenti. La domanda non è più “sai programmare?” ma “sai cosa costruire?”

Se il vibe coding democratizza la creazione di software, il CRISPR democratizza la creazione di vita. Colossal, la startup guidata da George Church — professore ad Harvard, fondatore del Human Genome Project e figura che nel mondo della genetica occupa lo stesso spazio che Musk occupa nella tecnologia — sta tentando di riportare in vita i mammut lanosi. Non quelli dei dinosauri: quelli estinti appena 3.500 anni fa, quando le piramidi erano già vecchie. Il progetto non è nostalgia paleontologica: i mammut compattavano la neve della tundra, mantenendo il permafrost freddo e impedendo il rilascio di metano intrappolato nel sottosuolo. Riportarli significherebbe riequilibrare un ecosistema che la loro assenza ha destabilizzato per millenni. Ma le ragioni vanno oltre l’ecologia: comprendere i meccanismi genetici di resistenza al freddo, affinare tecniche di editing genetico sempre più precise, esplorare i confini di ciò che la biologia sintetica può fare quando è guidata da un’intelligenza computazionale. Il dato di sfondo è vertiginoso: si stima che sei specie si estinguano ogni ora. La de-estinzione appare come la classica soluzione contorta a un problema creato dall’uomo, ma se prevenire le estinzioni resta difficile, sviluppare la tecnologia per invertirle diventa un’assicurazione sulla biodiversità. Il parallelo con il software è esatto: così come il vibe coding permette a chiunque di generare codice senza saperlo scrivere, il CRISPR permetterà di progettare organismi senza comprenderne ogni singolo gene. La domanda è se siamo pronti per un mondo dove la vita, come il software, diventa un prodotto iterabile (🦖 ff.4.3 Mammut resuscitati dall’estinzione).

C’è un numero che racconta la dismisura meglio di qualsiasi metafora: per abbattere l’errore di classificazione su ImageNet sotto la soglia del 5%, i modelli di deep learning hanno dovuto consumare un’energia paragonabile all’impronta carbonica di un’intera città. Nel 2020 il miglior sistema scendeva appena sotto il dieci per cento; ogni punto percentuale in meno richiedeva un ordine di grandezza in più di calcolo, un’escalation che i ricercatori chiamano “scaling law” e gli ambientalisti chiamano disastro. I parametri delle reti neuromorfe crescono esponenzialmente — GPT-4 ne ha oltre un trilione — e il video di Jim Carrey inserito digitalmente in The Shining tramite deepfake ha mostrato al grande pubblico cosa significa addestrare un modello “grande come New York”: non è solo potenza, è fame energetica strutturale (🏙️ ff.2.1 Un modello “grande” come New York). Ma l’AI generativa non produce solo inquinamento: produce anche meraviglia disturbante. Nel giro di pochi mesi, i social si sono riempiti di Harry Potter in stile Pixar, diretto da Wes Anderson con simmetrie ossessive e palette pastello. Poi i personaggi sono diventati bodybuilder — Hermione con i bicipiti di Schwarzenegger, Silente con il fisico di un culturista professionista — e infine le foto generate del “rave dopo la Coppa Tre Maghi”, con Hogwarts trasformata in un festival estivo con luci stroboscopiche. Benedict Cumberbatch come Sherlock Holmes in versione anime. Ogni settimana un nuovo esperimento visivo, ogni settimana la dimostrazione che lo “stile” è diventato un parametro regolabile, non più il frutto di decenni di pratica artigianale. L’estetica è diventata un prompt (🧙 ff.63.1 Harry Potter tra Pixar, steroidi e rave estivi). E mentre le immagini si moltiplicano, il tempo si comprime. Ogni inizio anno porta previsioni destinate a sbriciolarsi nel giro di settimane. Neil DeGrasse Tyson lo ripete: la mente umana pensa in linea retta, ma i trend tecnologici crescono su curve esponenziali — e l’errore di sottovalutazione si accumula finché non diventa irrecuperabile. Quando OpenAI ha rilasciato o3, la precisione sui benchmark di ragionamento matematico è raddoppiata in pochi mesi rispetto alla versione precedente. Raoul Pal, ex Goldman Sachs e fondatore di Real Vision, ha fissato una scadenza brutale: cinque anni. Entro quel termine, dice, il sistema socio-finanziario come lo conosciamo perderà senso — non per un crollo, ma per obsolescenza. Se l’AI raddoppia le prestazioni ogni trimestre e la finanza tradizionale aggiorna i modelli ogni anno, la forbice si allarga fino a spezzarsi (💸 ff.112.1 5 anni per fare soldi).